- Test di Significatività delle Correlazioni

- 1. Il confronto delle correlazioni da campioni indipendenti

- 2. Confronto delle correlazioni da campioni dipendenti

- 3. Test indipendenza lineare (Test contro 0)

- 4. Test delle correlazioni rispetto a un valore fisso

- 5. Calcolo degli intervalli di confidenza delle correlazioni

- 6. Fisher-Z-Transformation

- 7. Calcolo del coefficiente di correlazione Phi rPhi per dati binari

- 8. Calcolo della media ponderata di una lista di correlazioni

- 9. Trasformazione delle dimensioni dell’effetto r, d, f, Odds Ratioand eta square

- 10. Calcolo delle correlazioni lineari

- Letteratura

Test di Significatività delle Correlazioni

- Confronto delle correlazioni da campioni indipendenti

- Confronto delle correlazioni da dipendente di campioni

- Test di lineare indipendenza (Test contro 0)

- Test correlazioni contro un valore fisso

- Calcolo degli intervalli di confidenza delle correlazioni

- Fisher-Z-Trasformazione

- Calcolo del Phi coefficiente di correlazione rPhi per categoriale dati

- Calcolo della media ponderata di un elenco di correlazioni

- Trasformazione delle dimensioni degli effetti r, d, f, Odds Ratioand eta square

- Calcolo delle correlazioni lineari

1. Il confronto delle correlazioni da campioni indipendenti

Le correlazioni, che sono state recuperate da campioni diversi, possono essere testate l’una contro l’altra. Esempio: Immagina, vuoi testare, se gli uomini aumentano il loro reddito considerevolmente più velocemente delle donne. Si potrebbe f. e. raccogliere i dati su età e reddito da 1 200 uomini e 980 donne. La correlazione potrebbe ammontare a r = .38 nella coorte maschile e r = .31 nelle donne. C’è una differenza significativa nella correlazione di entrambe le coorti?

| n | r | |

| Correlazione 1 | ||

| Correlazione 2 | ||

| Statistica Test z | ||

| Probabilità p | ||

(il Calcolo secondo l’Eid, Gollwitzer & Schmidt, 2011, pp. 547; lato singolo test)

2. Confronto delle correlazioni da campioni dipendenti

Se diverse correlazioni sono state recuperate dallo stesso campione, questa dipendenza all’interno dei dati può essere utilizzata per aumentare la potenza del test di significatività. Considera il seguente esempio fittizio:

- 85 i bambini di grado 3 sono stati testati con test sull’intelligenza (1), abilità aritmetiche (2) e comprensione della lettura (3). La correlazione tra intelligenza e abilità aritmetiche ammonta a r12 = .53, l’intelligenza e la lettura è correlata con r13 = .41 e aritmetica e lettura con r23 = .59. La correlazione tra intelligenza è una capacità aritmetica superiore alla correlazione tra intelligenza e comprensione della lettura?

| n | r12 | r13 | r23 |

| Statistica Test z | |||

| Propability p | |||

(il Calcolo secondo l’Eid et al., 2011, S. 548 f.; singola prova parteggiata)

3. Test indipendenza lineare (Test contro 0)

Con la seguente calcolatrice, è possibile verificare se le correlazioni sono diverse da zero. Il test si basa sulla distribuzione t dello Studente con n-2 gradi di libertà. Un esempio: la lunghezza del piede sinistro e il naso di 18 uomini è quantificata. La lunghezza è correlata con r = .69. La correlazione è significativamente diversa da 0?

| n | r |

| Statistica Test t | |

| Propability p (single-sided) | |

| Propability p (su due lati) |

(il Calcolo secondo l’Eid et al., 2011, S. 542; prova su due lati)

4. Test delle correlazioni rispetto a un valore fisso

Con il seguente calcolatore, è possibile verificare se le correlazioni sono diverse da un valore fisso. Il test utilizza la trasformazione Fisher-Z.

| n | r | ρ (valore, la correlazione è testato contro) |

| Statistica Test z | ||

| Propability p | ||

(il Calcolo secondo l’Eid et al., 2011, S. 543f.; test a due lati)

5. Calcolo degli intervalli di confidenza delle correlazioni

L’intervallo di confidenza specifica l’intervallo di valori che include una correlazione con una data probabilità (coefficiente di confidenza). Maggiore è il coefficiente di confidenza, maggiore è l’intervallo di confidenza. Comunemente, valori intorno .9 sono usati.

| n | r | Fiducia Coefficiente |

|

| intervallo di Confidenza | |||

(il Calcolo secondo l’Eid et al., 2011, S. 545f.; test a due lati)

Il calcolo diventa impreciso con campioni di grandi dimensioni e valori di correlazione estremi a causa della precisione limitata dei numeri in virgola mobile in Javascript.

6. Fisher-Z-Transformation

La Fisher-Z-Transformation converte le correlazioni in una misura distribuita quasi normalmente. È necessario per molte operazioni con correlazioni, ad es. quando si calcola la media di un elenco di correlazioni. Il seguente convertitore trasforma le correlazioni e calcola anche le operazioni inverse. Si prega di notare, che il Fisher-Z è digitato in maiuscolo.

| Valore | Trasformazione | Risultato |

7. Calcolo del coefficiente di correlazione Phi rPhi per dati binari

rPhi è una misura per dati binari come conteggi in diverse categorie, ad esempio pass/fail in un esame di maschi e femmine. È anche chiamato coefficiente di contingenza o Phi di Yule. La trasformazione in dCohen avviene tramite il calcolatore delle dimensioni degli effetti.

| Gruppo 1 | Gruppo 2 | |

| Categoria 1 | ||

| Categoria 2 | ||

| rPhi | ||

| Dimensione dell’Effetto dcohen | ||

8. Calcolo della media ponderata di una lista di correlazioni

A causa della distribuzione obliqua delle correlazioni(vedi Trasformazione di Fisher-Z), la media di una lista di correlazioni non può essere calcolata semplicemente costruendo la media aritmetica. Di solito, le correlazioni vengono trasformate in valori Fisher-Z e ponderate per il numero di casi prima di fare la media e ritrasformare con un Fisher-Z inverso. (2011, pp. 544) suggeriscono invece di utilizzare la correzione di Olkin & Pratt (1958), poiché le simulazioni lo hanno mostrato per stimare la correlazione media in modo più preciso. Il seguente calcolatore calcola sia per voi, il “tradizionale Fisher-Z-approccio” e l’algoritmo di Olkin e Pratt.

| Per saperne di più clicca qui | |

Inserisci le correlazioni nella colonna A e il numero di casi nella colonna B. Puoi anche copiare i valori dalle tabelle del tuo programma di fogli di calcolo. Infine fare clic su ” OK ” per avviare il calcolo. Alcuni valori già compilati a scopo dimostrativo.

9. Trasformazione delle dimensioni dell’effetto r, d, f, Odds Ratioand eta square

Le correlazioni sono una misura delle dimensioni dell’effetto. Quantificano l’entità di un effetto empirico. Ci sono anche una serie di altre misure di dimensione degli effetti, con dCohen probabilmente il più importante. Le diverse misure di dimensione dell’effetto possono essere convertite in un’altra. Si prega di dare un’occhiata alle calcolatrici online nella pagina Calcolo delle dimensioni degli effetti.

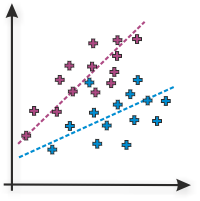

10. Calcolo delle correlazioni lineari

Il calcolatore online calcola le correlazioni lineari di pearson o momento prodotto di due variabili. Inserire i valori della variabile 1 nella colonna A e i valori della variabile 2 nella colonna B e premere ‘OK’. Come dimostrazione, i valori per una correlazione positiva elevata sono già compilati per impostazione predefinita.

| Dati | lineare Correlazione rPearson |

Determinazione coefficiente r2 |

Interpretazione |

Letteratura

Molti test di ipotesi su questa pagina sono basati su Eid et al. (2011). jStat viene utilizzato per generare la distribuzione t dello studente per testare le correlazioni l’una contro l’altra. L’elemento foglio di calcolo è basato su Handsontable.

- Eid, M., Gollwitzer, M., & Schmitt, M. (2011). Statistik und Forschungsmethoden Lehrbuch. Beltz.

Si prega di utilizzare la seguente citazione: Lenhard, W. & Lenhard, A. (2014). Test di ipotesi per confrontare le correlazioni. disponibile: https://www.psychometrica.de/correlation.html. Bibergau (Germania): Psicometrica. DOI: 10.13140 / RG.2.1.2954.1367